Den konventionella visdomen säger: "Om du inte vill att dina uppgifter ska användas, dra dig tillbaka från allt".

Vi säger: "Om dina uppgifter ändå samlas in, är det mer rationellt att påverka hur de används".

Det är inte: "Borde företag ha mina uppgifter?" (De har dem redan).

Den verkliga frågan är: "Bör mina data bidra till att skapa en bättre AI för alla?"

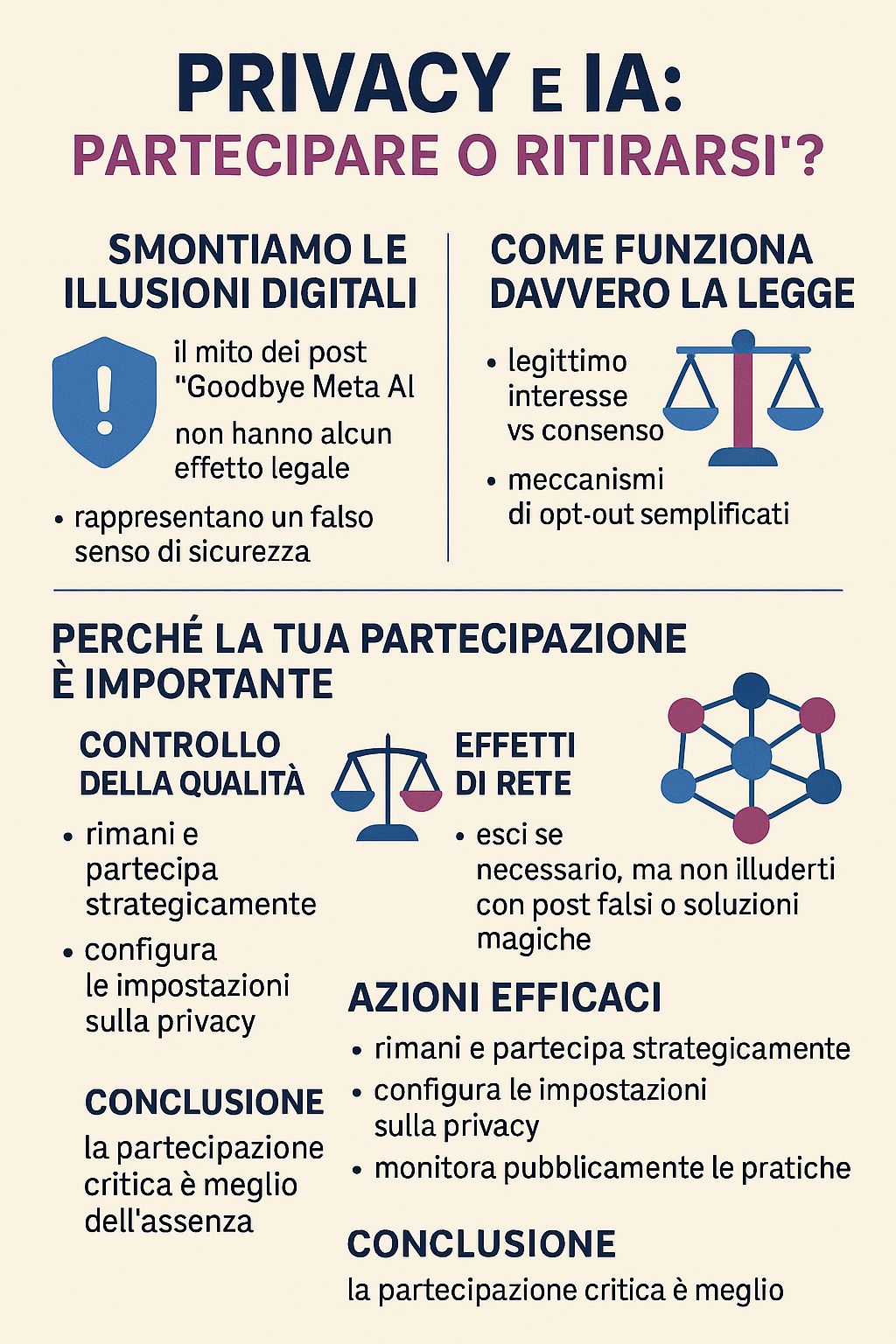

Innan man bygger upp ett seriöst argument är det viktigt att avslöja en farlig illusion som cirkulerar på sociala medier: de virala inläggen ”Goodbye Meta AI” som lovar att skydda dina data genom att du helt enkelt delar ett meddelande.

Den obekväma sanningen: dessa inlägg är helt falska och kan göra dig mer sårbar.

Som Meta själv förklarar är det inte en giltig form av protest att dela meddelandet ”Goodbye Meta AI”. Dessa inlägg:

Den virala framgången för dessa inlägg avslöjar ett djupare problem: vi föredrar enkla och illusoriska lösningar framför komplexa och välgrundade beslut. Att dela ett inlägg får oss att känna oss aktiva utan att vi behöver anstränga oss för att verkligen förstå hur våra digitala rättigheter fungerar.

Men integriteten kan inte försvaras med memes. Den försvaras med kunskap och medvetna handlingar.

Från och med den 31 maj 2025 har Meta infört ett nytt system för träning av AI som använder ”berättigat intresse” istället för samtycke som rättslig grund. Detta är inte ett kryphål, utan ett lagligt verktyg som föreskrivs i GDPR.

Legitimt intresse gör det möjligt för företag att behandla data utan uttryckligt samtycke om de kan visa att deras intresse inte väger tyngre än användarens rättigheter. Detta skapar en gråzon där företag "skräddarsyr lagen" genom interna utvärderingar.

Användningen av icke-anonymiserade data medför "höga risker för modellomvändning, minnesläckor och extraktionssårbarheter". Den beräkningskraft som krävs innebär att endast aktörer med mycket hög kapacitet kan utnyttja dessa data effektivt, vilket skapar systemiska asymmetrier mellan medborgare och stora företag.

Nu när vi har klargjort den juridiska och tekniska verkligheten kan vi bygga upp argumenten för strategisk deltagande.

När medvetna människor ger upp, tränas AI på dem som är kvar. Vill du att AI-systemen huvudsakligen ska baseras på data från personer som:

Fördomar i AI uppstår när träningsdata inte är representativa. Din medverkan bidrar till att säkerställa:

AI-system förbättras med skala och mångfald:

Om du använder AI-baserade funktioner (sökning, översättning, rekommendationer, tillgänglighetsverktyg) bidrar din medverkan till att förbättra dem för alla, inklusive framtida användare som har störst behov av dem.

Din integritet förändras inte nämnvärt mellan att välja att delta eller avstå från AI. Samma data används redan för att:

Skillnaden är om dessa data också bidrar till att förbättra AI för alla eller om de endast tjänar plattformens omedelbara kommersiella intressen.

Det är precis därför som ansvarsfulla människor som du bör delta. Att dra sig tillbaka stoppar inte utvecklingen av AI, utan tar bara bort din röst från den.

AI-systemen kommer att utvecklas ändå. Frågan är: med eller utan bidrag från människor som reflekterar kritiskt över dessa frågor?

Förståeligt. Men tänk på detta: skulle du föredra att AI-system byggdes med eller utan bidrag från personer som delar din skepsis mot stora företag?

Din misstro är just anledningen till att ditt kritiska deltagande är så värdefullt.

Artificiell intelligens blir verklighet, oavsett om du deltar eller inte.

Ditt val är inte om AI kommer att byggas, utan om den AI som kommer att byggas kommer att återspegla värderingarna och perspektiven hos de människor som noggrant reflekterar över dessa frågor.

Att välja bort är som att inte rösta. Det stoppar inte valet, det betyder bara att resultatet inte kommer att ta hänsyn till ditt bidrag.

I en värld där endast aktörer med mycket hög datorkapacitet kan tolka och effektivt utnyttja dessa data kan din kritiska röst i utbildningen ha större inverkan än din frånvaro.

Stanna kvar och delta strategiskt om:

Och under tiden:

Men lura dig inte med:

Din individuella avsägelse har minimal inverkan på din integritet, men att stanna kvar har en verklig inverkan på alla.

I en värld där AI-system kommer att styra informationsflödet, besluten och interaktionen mellan människor och teknik är frågan inte om dessa system ska finnas, utan om de ska inkludera synpunkter från reflekterande och kritiska människor som du.

Ibland är det mest radikala man kan göra inte att ge upp. Ofta är det mest radikala att stanna kvar och se till att ens röst blir hörd.

Anonym

Det handlar inte om att blint lita på företag eller ignorera integritetsfrågor. Det handlar om att inse att integritet inte försvaras med memes, utan med strategisk och medveten delaktighet.

I ett ekosystem där maktobalansen är enorm kan din kritiska röst i AI-utbildningen ha större inverkan än din protestartade frånvaro.

Oavsett vad du väljer, välj medvetet, inte med digitala illusioner.

Ett sympatiskt stycke även för "integritetsheremiterna" – de rena själarna som tror att de kan undkomma digital spårning helt och hållet genom att leva offline som tibetanska munkar år 2025.

Spoiler: även om du flyttar till en avlägsen stuga i Dolomiterna finns dina uppgifter redan överallt. Din husläkare använder digitala system. Banken där du har dina besparingar för att köpa ved spårar varje transaktion. Byggvaruhuset i byn har kameror och elektroniska betalningssystem. Till och med brevbäraren som levererar dina räkningar bidrar till logistikdatasätt som matar optimeringsalgoritmer.

Att helt dra sig tillbaka från det digitala livet år 2025 innebär i princip att man utesluter sig själv från det civila samhället. Man kan avstå från Instagram, men man kan inte avstå från hälso- och sjukvården, bankväsendet, utbildningssystemet eller arbetsmarknaden utan att det får dramatiska konsekvenser för livskvaliteten.

Och medan du bygger din anti-5G-stuga fortsätter dina uppgifter att finnas kvar i databaser hos sjukhus, banker, försäkringsbolag, kommuner och skattemyndigheter, och används ändå för att träna system som kommer att påverka framtida generationer.

Eremitens paradox: din protest mot isolering hindrar inte AI-system från att tränas på data från mindre medvetna människor, men det utesluter dig från möjligheten att påverka utvecklingen i en mer etisk riktning.

I grund och botten har du erövrat den orörda moraliska renheten hos den som betraktar historien från läktaren, medan andra – mindre upplysta men mer närvarande – skriver spelreglerna.

Oavsett vad du väljer, välj medvetet, inte med digitala illusioner.

Citerade artiklar:

Mer information om GDPR och berättigat intresse:

Officiella resurser:

Konkreta åtgärder: om du befinner dig i Europa, kontrollera de officiella procedurerna för att välja bort detta hos dataskyddsmyndigheten. För allmän information, se sekretessinställningarna och användarvillkoren för din plattform. Och kom ihåg: inga inlägg på sociala medier har någon juridisk giltighet.